Datenschutz-Philosophie

Immer dieser böse Datenschutz?

Datenschutz ist zweifelsohne ein „Lieblings-Hassobjekt“ in Deutschland. Wenn man sich ein wenig in Zeitung, Rundfunk und sonstigen Medien umschaut, sieht man, dass quasi alle gerne sich „über den Datenschutz“ beschweren, wenn irgendetwas nicht klappt. Zunächst habe ich einige Beispiele rausgesucht, die aufzeigen sollen, woran „der Datenschutz“ mal wieder Schuld sein soll:

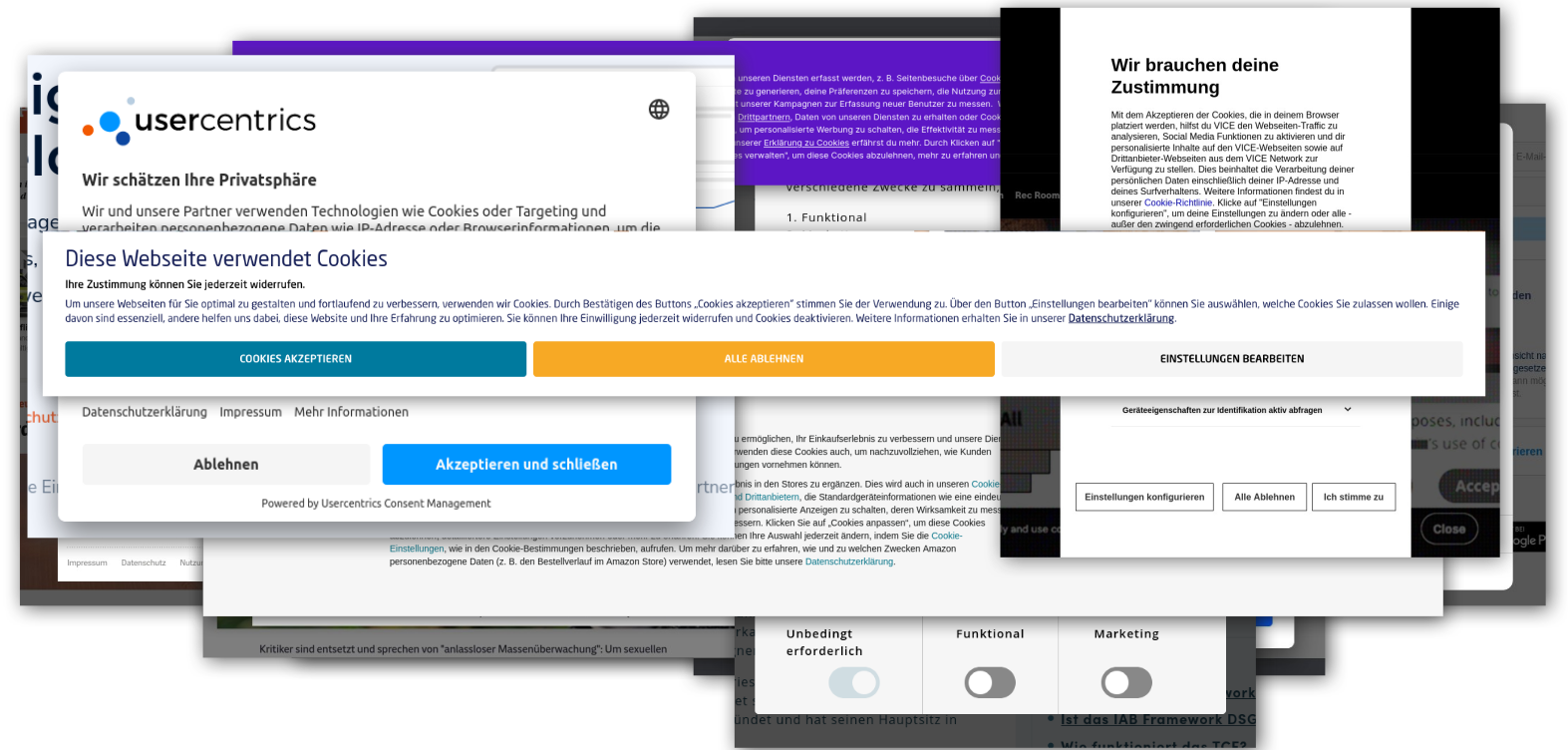

Cookie-Banner

Niemand, wirklich absolut NIEMAND mag Cookie-Banner. Sie sind einfach nur unfassbar nervig. Wir kennen sie alle, wir hassen sie alle. Sie sind überall. Sie nerven und sie sind eine grauenhafte Verschwendung menschlicher Lebenszeit und Aufmerksamkeit. Auf eine fast schon wunderschöne Art zynisch sind gerade die Cookie-Banner, die die Aussage beinhalten, dass den Webseitenbetreiber*innen Datenschutz wichtig sei, oder man die Kontrolle über die eigenen Daten habe, aber gleichzeitig zum Abwählen von Cookies zigtausende Klicks notwendig sind.

Wenn sich Leute über Cookie-Banner aufregen, wird die Kritik meistens mit einem einfachen Schulterzucken auf das europäische Datenschutzrecht abgelenkt, welches – angeblich – für diesen Schrecken der Menschheit verantwortlich sei.

Dies ist aber ganz eindeutig falsch.

Ich würde sogar davon ausgehen, dass es in den meisten Fällen eine bewusste Lüge ist, um die Nutzer*innen zu täuschen und die Webseitenbetreiber*innen gut darstehen zu lassen.

Denn: das Datenschutzrecht sagt (erst einmal), dass es verboten ist, die Nutzer*innen durch das halbe Internet zu tracken, dass man es also nicht machen darf, und damit könnte die ganze Sache schon ihr Ende haben. Aber die Webseitenbetreiber*innen wollen halt nun einmal so gerne die Nutzer*innen tracken, anschließend die Daten zu Gewinn machen und somit reich werden (oder bleiben). Die einzige Lösung, die das Gesetz dafür hergibt, die das Tracking rechtmäßig machen würde, wäre, wenn die Nutzer*innen freiwillig in das Tracking einwilligen. Aber natürlich sind nur wenige Nutzer*innen bereit, dies zu tun. Warum auch, denn man hat ja gar nichts davon, und um Webseitenbetreiber*innen zu unterstützen, gibt es viel effizientere, einfachere und direktere Wege, z. B. Spenden, bezahlte Benutzerkonten, Premiumfunktionen oder ähnliches. Aber, wie man es in guter Tradition schon vom Erlkönig kennt, wenn die Nutzer*innen nicht einwilligen wollen, dann muss man sie eben dazu zwingen. In diesem Fall passiert das darüber, dass man die Cookie-Banner so verwirrend, grauenvoll und umständlich gestaltet, dass die Nutzer*innen entweder „ganz zufällig“ oder einfach, weil sie besseres zu tun haben, auf den Einwilligungsknopf drücken, was wiederum die Webseitenbetreiber*innen glücklich macht, da sie nun so tun können, als hätten sie eine freiwillige Einwilligung erhalten.

An Cookie-Bannern ist also nicht das Datenschutzrecht Schuld, sondern die Böswilligkeit (oder Inkompetenz) von Webseiten-Betreiber*innen.

Hintergrundinfo:

Die rechtlichen Hintergründe für Cookie-Banner stehen in Artikel 5 III der e-Privacy-Richtlinie. Dort wird vorgeschrieben, dass Cookies nur gesetzt werden dürfen, wenn die Nutzer*innen eingewilligt haben, oder das Cookie unbedingt erforderlich ist, damit ein Dienst angeboten werden kann, der von den Nutzer*innen ausdrücklich gewünscht wurde (dies sind die berühmten „technisch notwendigen Cookies“). Ich würde davon ausgehen, dass 99% aller „gutartigen Cookies“ unter die technische Notwendigkeit gefasst werden können, sodass die Einwilligung in der Regel nur für Tracking und vergleichbares erforderlich ist.

Vllt. Ist euch auch schon aufgefallen, dass viele Cookie-Banner sehr ähnlich aussehen und gleich gegliedert sind. Das liegt daran, dass das „Internet Advisory Board“, eine Vereinigung der Internet-Werbedienste, ein „Consent Framework“ entwickelt hat, mit dem Nutzer*innen möglichst effektiv zur Einwilligung genötigt werden sollen. Zum Glück hat die belgische Datenschutzbehörde im Februar 2022 dieses TCF für unvereinbar mit dem Datenschutzrecht erklärt. Auch hat z. B. das LG München I mit Urteil vom 29.11.2022 in einem auf dem TCF basierenden Cookie-Banner einen Rechtsverstoß gesehen

Es ist daher zu hoffen, dass diese unsägliche Praxis bald aufhört.

Pandemiebekämpfung

Besonders beliebt waren die Vorwürfe an den Datenschutz auch immer dann, wenn die Politik (angeblich) bei der Bekämpfung der COVID-19-Pandemie versagt hat. So haben beispielsweise einzelne Intensivmediziner*innen in Zeitungen behauptet, dass Datenschutz die optimale Bekämpfung der Corona-Pandemie verhindert (Quelle, inzwischen gelöscht). Dem tritt dann der Bundesbeauftragte für den Datenschutz, Prof. Ulrich Kelber, entgegen und erklärt, dass keine einzige Maßnahme zur Pandemiebekämpfung am Datenschutz gescheitert sei (Quelle).

Ein besonders schönes Beispiel war auch die Ansage eines Gesundheitsamtes, man könne keine (kumulierten!) Corona-Zahlen veröffentlichen, da dem der Datenschutz entgegenstehe (Quelle). Das kann schon deshalb nicht stimmen, weil anonyme Daten, wie es bei kumulierten Daten wohl in der Regel der Fall sein dürfte, gar nicht dem Datenschutzrecht unterliegen.

Bitte versteht mich an dieser Stelle nicht falsch: Intensivmediziner*innen und Mitarbeitende in Gesundheitsämtern leisteten und leisten immer noch unmenschliches, um COVID-19 in den Griff zu bekommen. Aber öffentlich den Datenschutz zu diskreditieren hilft am Ende niemanden.

Ein typisches weiteres Beispiel ist auch immer die Corona-Warn-App, wo gesagt wird, dass diese nicht so effektiv funktionieren würde „wegen des Datenschutzes“ oder wegen diesem zu spät veröffentlicht wurde. Dies ist aber beispielsweise eine Lüge, denn einerseits ist eine dezentrale App, wie die CWA, deutlich effektiver als zentrale aLternativen, bei denen Warnungen erst über die Gesundheitsämter und nicht direkt zu den Kontakten gehen. Andererseits war das hohe Datenschutzniveau auch wichtige Voraussetzung dafür, dass viele Menschen der App überhaupt erst vertraut und sie sich installiert haben.

Ihr müsst an dieser Stelle auch nicht mir vertrauen; denn Menschen, die mit Gesundheitsämtern zusammenarbeiten und viel mehr Ahnung von sinnvoller Digitalisierung als ich haben, sagen ja das gleiche: allgemein, spezifisch zur CWA.

Abgesehen davon: ich bin keine Person, die sich mit Epidemiologie und Infektionsschutz besonders auskennt, aber die Frage, ob so etwas wie die Abschaffung der Maskenpflicht, keine Impfpflicht oder Tests schwer zugänglich zu machen, nicht am Ende der Pandemiebekämpfung mehr geschadet hat, als ein bisschen Datenschutz, halte ich schon für berechtigt.

Der Nikolaus?

Teilweise ist es ja auch etwas absurd, was dem Datenschutz alles vorgeworfen wird. Laut einer n-tv-Kolumne vom 29. Oktober 2021, sei der Datenschutz daran Schuld, dass der Nikolaus nicht kommen kann??? (Quelle)

Ich weiß ja nicht… Aber natürlich ergibt es auch irgendwie Sinn, die Liste mit den braven und frechen Kindern ist sicher datenschutzrechtlich hoch problematisch. ;)

Menschenleben???

Es gibt sogar noch schlimmere Vorwürfe, als dass Datenschutz am Ausbleiben des Nikolaus Schuld sei (man mag es kaum glauben!). Angeblich sei Datenschutz nämlich auch noch am Tod von Menschen Schuld (Quelle 1) (Quelle 2), was natürlich in jeder Hinsicht eine Katastrophe wäre.

Dem ersten verlinkten Artikel (von heise online) ist inzwischen übrigens eine Art „Richtigstellung“ des Bundesdatenschutzbeauftragten angefügt. Der zweite Artikel ist hinter einer Paywall/Ad-Blocker-Wall und es war mir daher bedauerlicherweise weder Geld noch Zeit wert, sich diesen genauer anzuschauen. In den Vorwürfen geht es, soweit ich das sehe, darum, dass Rettungskräfte irgendwelche Daten nicht haben können, die notwendig seien. Das ist aber halt schon aus dem Grund erst einmal unsinnig, weil es in der DSGVO ausdrückliche Ausnahmen für „lebenswichtige Interessen“ gibt und was wäre ein „lebenswichtiges Interesse“, wenn nicht das Überleben selber?

Ein neues Image

Zwar wirken die vorgenannten Beispiele teilweise fast schon ein wenig kampagnenhaft, aber man kann trotzdem ganz gut sehen, dass Datenschutz in Deutschland keinen guten Ruf hat.

Und was macht man als (mehr oder i.d.R. weniger) seriöses Unternehmen, wenn man einen schlechten Ruf hat? Genau. Ein Rebranding.

Vielleicht sollten wir das auch mal mit dem Datenschutz probieren; vielleicht braucht Datenschutz ein neues Image?

Was ist Datenschutz?

Dabei stellt sich als erstes die Frage, was Datenschutz eigentlich ist. Das Problem ist, dass der Begriff ein wenig irreführend ist. Es geht nämlich nicht darum, Daten zu schützen, sondern Menschen. Nun ist der Begriff „Menschenschutz“ leider ein klitzekleines bisschen zu unspezifisch und kann wohl fast alles bedeuten.

Daher bietet es sich an, den Begriff etwas zu präzisieren. Wovor schützt Datenschutz denn die Menschen? Genau: Daten. Datenschutz ist damit erstmal (stark vereinfacht) Schutz vor Daten.

Allerdings sind auch nicht alle Daten für den Datenschutz interessant, z. B. die Zahl der Monde des Planeten Jupiter (79) oder irgendwelche statistischen Erhebungen über das Wetter sind nichts, wovor man Menschen schützen muss (außer sie haben Angst vor Statistik, aber auch dafür ist der Datenschutz kein adäquates Mittel). Datenschutz fokussiert sich daher auf Daten, die sich auf bestimmte Menschen beziehen, wie z. B. das Alter einer Person, ihr Geschlecht oder welche Mastodon-Tröts sie gestern um 20:19 favorisiert hat. Diese Daten nennt man „personenbezogene Daten“. Datenschutz ist daher vielmehr Schutz vor personenbezogenen Daten.

Hintergrundinfo:

Wieso diese personenbezogenen Daten besonders „spannend“, bzw. gefährlich sind, steht etwas weiter hinten in diesem Text. Unabhängig davon sind natürlich auch andere Daten rechtlich interessant oder gefährlich, z. B. wenn es um systematische Vorurteile/Bias in Entscheidungssystemen geht, was gerade im KI-Bereich relevant ist. Diese Kategorien von Daten werden aber nicht vom Datenschutz beobachtet, sondern durch andere Rechtsgebiete, z. B. das Rechtsgebiet der Algorithmenkontrolle und des Rechts von Menschen, nicht ausschließlich technischen Entscheidungen ausgesetzt zu sein.

Eine weitere kleine Einschränkung des Begriffs ist noch erforderlich. Und zwar ist es uns relativ egal, wenn diese personenbezogenen Daten nur „ominös existieren“. Die reine Tatsache, ob ein Datum eine formal valide, wohlgeformte Information darstellt und ob es zutrifft oder falsch ist, ist aus rechtlicher Sicht kaum interessant. Viel spannender wird es erst, wenn etwas mit den Daten passiert. In der Fachsprache heißt das „Verarbeitung“ und das können z. B. die Speicherung von Daten sein, ihre Bearbeitung, die Berechnung von weiteren Informationen aus ihnen, ihr Abgleich oder ihre Löschung sein. Erst wenn auch so eine Verarbeitung vorliegt, ist das ganze für den Datenschutz interessant.

Mit anderen Worten: Datenschutz ist der Schutz vor der Verarbeitung personenbezogener Daten.

Das ist nur leider ziemlich sperrig, weshalb ich im weiteren Verlauf dieses Texts lieber weiter den Begriff Datenschutz verwenden werde (aber wenigstens wissen wir nun, worum es dabei überhaupt geht).

Das Problem – Wofür wir Datenschutz brauchen

Nachdem geklärt ist, was Datenschutz überhaupt bedeutet, stellt sich die Anschlussfrage, wofür wir diesen überhaupt brauchen. In der Argumentation wird häufig unterstellt, dass „rechtschaffene Bürger*innen“ Datenschutz überhaupt nicht benötigen würden und die einzigen Profiteure des Datenschutzes Kriminelle seien (häufig mit dem Claim „wer nichts zu verbergen hat, hat auch nichts zu befürchten“).

Diese Unterstellung ist falsch. Datenschutz erweist sich vielmehr als eine – gerade – auch für rechtschaffende Bürger*innen nützliche Angelegenheit.

Nobody’s Business

Ein erstes Argument, dass in der Debatte häufig übersehen wird, ist, dass Datenschutz und Privatsphäre schon sehr gut aus sich selbst heraus begründet sind. Es geht erst einmal niemanden etwas an, wer du bist, was du denkst und wie du handelst. Häufig wird gesagt, der Staat brauche dieses Wissen (für seine Ordnungsfunktion) oder Unternehmen bräuchten für irgendwelche Geschäftsmodelle Zugriff auf dieses Wissen, während man selber ja kein schutzwürdiges Interesse habe.

Aber das stimmt nicht: „Es geht niemanden etwas an“ ist ein sehr guter Grund, wenn es um persönliche Angelegenheiten geht, der erst einmal zu akzeptieren ist. Genauso wie es – was inzwischen gesellschaftlicher Konsens ist – inakzeptabel wäre, wenn andere Leute ohne meine Zustimmung in meine Tagebücher schauen würden, genauso inakzeptabel ist es, wenn andere Leute ohne meine Zustimmung Informationen über mich sammeln und verwerten. Das gilt gerade im Informationszeitalter, in dem Online-Verhaltensdaten weitaus intimere Informationen enthalten können (ggf. auch verdeckt und nur durch Datenanalyse auffindbar), als in irgendeinem Tagebuch denkbar.

Insbesondere auch gilt dies vor dem Hintergrund, dass es im Informationszeitalter keine „belanglosen Daten“ mehr gibt. Wie David Kriesel auf dem 33c3 anschaulich demonstriert hat, lassen selbst einfachste Daten über die Arbeitsaktivität Rückschlüsse auf das Liebesleben der Betroffenen zu. Angesichts auch der Tatsache, dass es naheliegend ist, dass in der Zukunft noch weitere Analysemethoden und Rückschlüsse gefunden werden, an die heute noch niemand denkt, ist eine persönliche Zurückhaltung nachvollziehbar und (erst einmal, s.u.) zu akzeptieren.

Das Kriminellen-Argument

Häufig wird auch gesagt, dass Eingriffe in Datenschutz und Privatsphäre erforderlich seien, um Kriminalität zu bekämpfen. Besonders „beliebte“ Straftaten, die damit aufgedeckt werden sollen, sind Terrorismus und sexueller Missbrauch (insb. gegenüber Minderjährigen). Ein aktuelleres Beispiel wäre der Vorschlag der EU für die Chat-Kontrolle (Quelle), die angeblich der Bekämpfung des sexuellen Missbrauchs gegenüber Minderjährigen im Internet dienen soll.

Wenn man sich das in der Praxis anschaut, scheinen die Tools stattdessen deutlich lieber zur Bekämpfung von Drogenkriminalität eingesetzt zu werden (Quelle).

Unabhängig davon wie man jedoch die Wahrheitsmäßigkeit der Aussagen der Politik und die Prioritäten der Justiz einschätzt, muss man feststellen, dass das Argument, dass Eingriffe in den Datenschutz erforderlich seien, um (Schwerst-)Kriminalität zu bekämpfen, schon in sich widersprüchlich ist.

So liegt es mehr als nahe, dass die Hemmschwelle für einen Mord oder einen sexuellen Missbrauch deutlich höher liegt als dafür, illegal Daten zu verschlüsseln oder geheimzuhalten; man sollte wohl eher von astronomischen als sonstigen Größenordnungen reden, die zwischen den beiden Schwellen liegen. Alleine schon die Vorstellung, dass eine terroristische Vereinigung einen bis ins letzte Detail ausgearbeiteten Plan entwickelt, aber in letzter Sekunde feststellt, dass sie dabei verschlüsselte Kommunikation verwenden, was illegal ist, und daher den Plan verwerfen, ist absurd. Dies hat aber zur Folge, dass durch solche Maßnahmen die wirklichen Kriminellen kaum beeinträchtigt werden, während die „normalen Bürger*innen“ massivsten Beeinträchtigungen in ihrem Datenschutz und in ihrer Privatsphäre ausgesetzt werden.

Wissen ist Macht (über die Person)

Der Spruch „Wissen ist Macht“ kommt ja keineswegs aus dem Nichts. Vielmehr ermöglicht uns Wissen über eine Person, über diese Person Macht auszuüben, sie zu beeinflussen. Das funktioniert im einfachsten Fall dergestalt, dass wir wissen, dass die Person etwas gesellschaftlich nicht anerkanntes getan hat, und man mit diesem Wissen die Person erpressen kann.

In den meisten Fällen ermöglichen personenbezogene Daten aber natürlich viel subtilere Methoden der Beeinflussung, die dennoch nicht weniger gefährlich sind – für die einzelnen Personen und die gesamte Gesellschaft.

Beispiel: Filterblasen

Ein erstes Beispiel für solch eine Gefahr, wie personenbezogene Daten genutzt werden können, um die Betroffenen (so nennt man die Personen, auf die sich die Daten beziehen) zu beeinflussen, sind die berühmten „Filterblasen“. Filterblasen treten auf, wenn soziale Netzwerke aus dem Verhalten der Nutzer*innen lernen und ihnen vorrangig solche Inhalte anbieten, die mit ihrem früheren Verhalten in Einklang stehen, da erwartet wird, dass dies zu mehr Interaktionen auf dem Netzwerk führt, was für die Betreiber*innen finanziell vorteilhaft ist. Solche Algorithmen würden nicht funktionieren (und demnach Filterblasen nicht entstehen), wenn sie nicht personenbezogene Daten verarbeiten könnten (z. B. die Interessen der Nutzer*innen oder ihr detailliertes Plattformverhalten, was alles personenbezogene Daten sind).

Als Beispiel könnte man annehmen, dass ich auf einem sozialen Netzwerk ein Katzenbild „like“. Dies wird dazu führen, dass mir in Zukunft vermehrt Katzenbilder angezeigt werden. Wenn ich auch diese regelmäßig „like“, werden mir mehr und mehr Katzenbilder angezeigt, bis irgendwann meine gesamte Timeline felin ist. Mit anderen Worten: ich werde immer mehr in die Katzenbild-Bubbel hineingesaugt.

Selbstverständlich ist das noch nicht so schlimm, wenn es nur um Katzenbilder geht. Aber ganz anders sieht es aus, wenn ich in eine Filterblase aus z. B. rechtsextremischem Propaganda gesogen werde. Da in den Filterblasen dann auch nur genehme Inhalte angezeigt werden und kein Widerspruch vorherrscht (bzw. dieser schnell ausgefiltert wird), wirken die Blasen wie Echokammern und verstärken die Radikalisierungseffekte noch.

Dies führt dann – insbesondere bekannt unter dem Stichwort „stochastischer Terrorismus“ – am Ende auch zu konkreter physischer Gewalt. Indem Datenschutz die Macht der Algorithmen insoweit begrenzt, trägt er auch seinen Teil zur Bekämpfung von Radikalisierung bei (Ironie des Schicksals: Datenschutz begünstigt also – entgegen der Ansicht des BMI – nicht Terrorismus, sondern hilft viel mehr bei seiner Bekämpfung…).

Beispiel: Wahlbeeinflussung

Während Filterblasen wahrscheinlich eher ein Nebenprodukt von Algorithmen sind, die auf Gewinnorientierung um jeden Preis gerichtet sind, lassen sich personenbezogene Daten auch nutzen, um gezielt und in böswilliger Absicht Menschen zu beeinflussen – zum Nachteil unserer Demokratie.

In den USA und im Vereinigten Königreich konnte man das sehr schön beobachten. Ein Unternehmen namens „Cambridge Analytica“ hatte sich Interaktionsdaten von Facebook-Nutzer*innen geholt und diese in einen Algorithmus gesteckt, der psychologische Persönlichkeitsprofile berechnet hat. Mit diesen Persönlichkeitsprofilen wurden dann hochspezialisierte Werbeanzeigen geschaltet, die besonders die jeweilige Zielgruppe ansprachen (sog. „Microtargeting“). Beispielsweise könnten dann Republikanern je nach Ausrichtung eher „christlich-fundamentalistische“, ausländerfeindliche oder verschwörungstheoretische Werbeanzeigen geschaltet werden. Mit dieser hochspezialisierten Werbung sollten die Wahlberechtigten zu einem bestimmten Wahlverhalten gedrängt werden, sowohl in positiver Richtung (wähle Partei X) als auch in negativer Richtung (wähle nicht)

Dieses Microtargeting, dass nur wegen der massenweisen Verarbeitung personenbezogener Daten funkioniert hat (und funktionieren kann), hat uns am Ende Trump und den Brexit beschert. Unabhängig davon aber, dass diese Wahlergebnisse schon an sich total schädlich waren, was aber ja mehr eine Sache der politischen Präferenz der Verwender*innen solches Microtargetings ist, muss man aber auch feststellen: personenbezogene Daten erlauben es, Wahlen zu beeinflussen. Damit kann die unregulierte Verarbeitung personenbezogener Daten eine Gefahr für unsere Demokratie darstellen.

<juristisches />

Das Bundesverfassungsgericht hat in seinem Volkszählungsurteil 1983 (BVerfG, Urt. v. 15. Dezember 1983, - 1 BvR 209/83 u.a. -) nicht nur sehr überzeugend, sondern auch erstaunlich visionär (wenn man den damaligen Stand der Technik bedenkt!) die Gründe zusammengefasst, wieso personenbezogene Daten zu schützen sind.

Hintergrund des Verfahrens war, dass ein Zensus stattfinden sollte, zu dessen Beantwortung die Bürger*innen verpflichtet werden sollten. Hiergegen gab es einen großen öffentlichen Aufschrei, da allgemein eine weitgehende staatliche Überwachung gefürchtet wurde, und es wurden Verfassungsbeschwerden in bis dahin ungesehener Zahl und Umfang an das Gericht gesendet. Das Bundesverfassungsgericht gab den Verfassungsbeschwerden statt und hob in seiner Begründung erstmals das „Grundrecht auf informationelle Selbstbestimmung“ hervor, welches u.a. die Grundlage des heutigen Datenschutzes ist.

In dem Urteil führt das Gericht zur Begründung seiner Entscheidung unter anderem aus:

Wer nicht [...] überschauen kann, welche ihn betreffende Informationen [...] seiner sozialen Umwelt bekannt sind, [...] kann in seiner Freiheit wesentlich gehemmt werden, aus eigener Selbstbestimmung zu planen oder zu entscheiden.

D.h., wenn ich zu befürchten habe, dass irgendwelche Sachen, die ich getan habe, allen anderen bekanntgemacht werden und den anderen mein Verhalten nicht gefällt und ich daraufhin sozial geächtet werden, dann werde ich vermutlich in „vorauseilendem Gehorsam“ darauf verzichten, Sachen zu tun, bei denen auch nur im Ansatz so ein Risiko besteht.

Besonders gefährlich wird das ganze dann, wenn die Informationen nicht nur weitergegeben werden, sondern auch noch in irgendeiner Weise dauerhaft gespeichert werden:

Wer unsicher ist, ob abweichende Verhaltensweisen jederzeit notiert und als Information dauerhaft gespeichert, verwendet oder weitergegeben werden, wird versuchen, nicht durch solche Verhaltensweisen aufzufallen.

Besonders spannend ist dies, wenn es sich um Verhaltensweisen handelt, die dem Staat oder mächtigen Unternehmen missfallen. Wenn ich beispielsweise auf eine Demonstration gehen und dort gegen staatliche Entscheidungen protestieren möchte, dann tue ich das nur, weil ich weiß, dass wir in einer Demokratie leben und mir daraus keine Nachteile gereichen dürften. Werden jedoch Informationen, z. B. über meine Teilnahme an der Demonstration, gespeichert, so muss ich Angst haben, was mit diesen passiert, insbesondere vor dem Hintergrund der Ungewissheit der Zukunft. Jetzt leben wir noch in einer Demokratie, in der die Regierung nicht versucht, Kritiker*innen mit Gewalt einzuschüchtern oder zu bedrohen. Aber niemand – wirklich niemand kann wissen, wie die Situation in fünf, zehn, zwanzig Jahren aussieht. Werden die Daten gespeichert, so kann man aber auch dann noch auf sie zugreifen, sodass man durch sie bis zum eigenen Lebensende gefährdet sein würde.

Da aber eine demokratische Gesellschaft auch auf Widerspruch und abweichende Verhaltensweisen angewiesen ist, sich geradezu darüber definiert, wird durch solche Effekte, die die Ausübung solcher Verhaltensweise unattraktiv machen, („chilling effects“) auch das gesellschaftliche Wohl insgesamt bedroht, oder wie das Bundesverfassungsgericht es formuliert:

Dies [beeinträchtigt] auch das Gemeinwohl, weil Selbstbestimmung eine elementare Funktionsbedingung eines auf Handlungs- und Mitwirkungsfähigkeit seiner Bürger begründeten freiheitlichen demokratischen Gemeinwesens ist.

Dem ist, denke ich, nichts hinzuzufügen.

Die Lösung – Wie Datenschutz gestaltet werden muss

Wenn man sich den vorherigen Abschnitt anschaut, stellt man fest, dass die Verarbeitung personenbezogener Daten auf vielfache Weise schädlich sein kann. Die naheliegendste Antwort wäre nun zu sagen, dass man einfach jede Verarbeitung personenbezogener Daten verbietet und damit – vermeintlich – aller Probleme sich entledigt zu haben.

Das ist jedoch natürlich keine befriedigende – oder auch nur akzeptable – Lösung, denn manche Datenverarbeitungen sind schlicht und einfach in einer demokratischen Gesellschaft zwingend erforderlich, da sie andernfalls nicht funktionieren könnte. Man denke hier nur an das Wahlberechtigtenverzeichnis oder die Liste der Wahlvorschläge, die geführt werden müssen, damit Wahlen stattfinden können. Oder daran, dass Rettungsdienste bei der Behandlung von Patient*innen selbstverständlich auch wissen müssen, welche (medizinisch relevanten) Eigenschaften die behandelte Person hat, also z. B. ihre Blutgruppe oder relevante Vorerkrankungen.

Akzeptable Verarbeitungen

Daher benötigen wir eine detailliertere Regelung, die nur diejenigen Verarbeitungen zulässt, die – gemäß gesellschaftlichem Konsens – als akzeptabel gelten, und nur diejenigen Verarbeitungen verbietet, die als missbräuchlich gelten. Dabei stellt sich natürlich die Frage, woran man diese „Missbräuchlichkeit“ pauschalisiert festmachen könnte.

Die Antwort hierauf ist, dass es auf den Zweck der Verarbeitung ankommt. Ein und die selbe Verarbeitung kann zu einem Zweck akzeptabel und zu einem anderen missbräuchlich sein. So ist es wohl gesellschaftlich akzeptiert, eine App zu haben, die für alle Nutzer*innen verfolgt, mit wem sie Kontakt hatten, wenn das der Bekämpfung der COVID-19-Pandemie dient, während eine gleichartige App zur Aufbau eines totalitären Überwachungsstaates als missbräuchlich angesehen werden dürfte.

Dies bedeutet aber nun, dass wir Kriterien festlegen müssen, wann ein Zweck als legitim gilt und wann er inakzeptabel ist. Nur in den wenigsten Fällen, nämlich wenn der Zweck offensichtlich schon illegal ist, genügt es jedoch, sich nur diesen anzuschauen. Im Übrigen müssen wir noch einen zweiten wesentlichen Faktor betrachten: das Interesse der Betroffenen. Hierbei kommt es auf das wirkliche Interesse der Betroffenen an, das von Nötigungsmaßnahmen und ähnlichem bereinigt ist. So kann man nicht davon ausgehen, dass eine Person, die entnervt auf „alles akzeptieren“ in einem Cookie-Banner klickt, ein Interesse an dem Setzen der Cookies hat. Gleichzeitig kann man dies natürlich auch nicht ausschließen, was die ganze Angelegenheit in der Praxis relativ kompliziert macht.

Wenn der Zweck und das Interesse der Betroffenen gleichlaufen, dann können wir den Zweck erst einmal als legitim und die auf diesen gestützte Datenverarbeitung als akzeptabel ansehen. Das ist unter anderem dann der Fall, wenn die Betroffenen und die Verantwortlichen (so nennt man diejenigen, die bestimmen, wie die Daten verarbeitet werden) einen Vertrag geschlossen haben und die Datenverarbeitung erforderlich ist, um diesen Vertrag zu erfüllen. Beispielsweise kann man wohl annehmen, dass die Bankkund*innen auch ein Interesse daran haben, dass die Bank die Überweisungsdaten speichert und verwaltet, da andernfalls ihr Konto natürlich nicht funktionieren würde. Außerdem kann man das annehmen, wenn die Betroffenen freiwillig einwilligen, d.h. mitteilen, dass sie dem Zweck zustimmen. Damit sie eine solche Aussage treffen können, müssen sie natürlich den Zweck kennen und auch im Übrigen informiert werden (zur Freiwilligkeit auch siehe den vorherigen Absatz).

Anders sieht es aus, wenn der Zweck und das Betroffeneninteresse von einander abweichen oder sogar einander entgegenstehen. In diesen Fällen muss eine Abwägung erfolgen. Hierbei gibt es Fälle, in denen der Zweck in der Regel ganz eindeutig überwiegen wird, wie dies z. B. bei Wahlberechtigtenverzeichnissen bei öffentlichen Wahlen der Fall ist; hier überwiegt der Zweck ganz eindeutig jedes mögliche Interesse, dass Personen haben, nicht in dem Verzeichnis geführt zu werden, da diese essentiell für eine demokratische Gesellschaft sind. Ein andere solches Beispiel wäre die Verarbeitung von Daten für die Strafverfolgung, denn auch wenn hier das Interesse der Betroffenen, dass ihre Daten nicht verarbeitet werden, aus ihrer Perspektive durchaus nachvollziehbar ist, besteht ein erhebliches und überwiegendes öffentliches Interesse, den Zweck zu verfolgen und Straftaten abzuurteilen, so sie begangen sind (diese Aussage ist in ihrer Pauschalität insbesondere auf das Verfahren vor dem Strafgericht beschränkt; im Ermittlungsverfahren sind hingegen strengere Abwägungen vorzunehmen, sodass z. B. nicht jede Überwachungsmaßnahme von sich aus als legitim gelten kann).

Andererseits gibt es auch Fälle, in denen in der Regel ganz eindeutig das Interesse der Betroffenen überwiegen wird. Das ist beispielsweise bei besonders sensitiven Daten, wie z. B. Gesundheitsdaten oder Daten über die politische, religiöse oder sexuelle Ausrichtung der Fall. Dies gilt insbesondere vor dem Hintergrund, dass wegen dieser Daten besonders gravierende Risiken im Hinblick auf Diskriminierung bestehen.

In den übrigen Fällen, kann keine pauschale Lösung gefunden werden. Hier muss dann im Einzelfall abgewogen werden, ob der Zweck, also das Interesse der Verantwortlichen, oder das Interesse der Betroffenen überwiegt. An dieser Stelle können dann auch sonstige gesellschaftliche Faktoren besonders berücksichtigt werden.

Sicherheit vor „den Bösen“

An dieser Stelle könnte der Beitrag zu Ende sein, aber wie man an der Scrollbar sieht, geht er noch ein wenig weiter. Der Grund dafür sind, wie fast immer, Menschen. Böse Menschen, um genau zu sein.

Denn die Abwägung zwischen Zweck und Betroffeneninteresse hilft nur bei denen weiter, die überhaupt bereit sind, sich an Gesetze und Regeln zu halten. Allerdings gibt es ja auch Geheimdienste oder Angreifer*innen. Auch die sollen mit den personenbezogenen Daten keinen Unfug treiben können.

Das Problem hieran ist, dass wir halt böse Hacker*innen (hier absichtlich mit dem Adjektiv „böswillig“, da die CCC-Definition gewählt wird) oder eben Leute haben, die sich nicht an Gesetze halten. Da hilft es erst einmal wenig, wenn im Gesetz ein bestimmtes Verbot steht. Daher müssen wir dafür sorgen, dass Daten, die verarbeitet werden, auch vor „den Bösen“ sicher sind.

Dies führt dazu, dass einerseits Sicherheitsanforderungen gestellt werden müssen. Diese können einerseits technischer Art (z. B. Verschlüsselung oder Pseudonymisierung) oder organisatorischer Art (z.B. Wachdienst bei einem Rechenzentrum) sein.

Hintergrundinfo:

Verschlüsselung ist ein Verfahren, bei dem sich die Beteiligten auf ein (nicht notwendigerweise allen Beteiligten bekanntes) Geheimnis einigen und dann eine Nachricht so verändert wird, dass sie nur noch mit Wissen des Geheimnisses wiederhergestellt werden kann. Pseudonymisierung ist ein Verfahren, bei dem Informationen sachlich so getrennt werden, dass der eine Teil nur mit Wissen des anderen Teils wieder einzelnen Personen zugeordnet werden kann; beide Teile müssen dann getrennt gespeichert werden und der Zugriff auf den identifizierenden Teil besonders geschützt werden.

Andererseits führt dies dazu, dass die Daten nur dort gespeichert werden dürfen, wo sie auch angemessen geschützt werden. In anderen Ländern, in denen die Geheimdienste massive Zugriffsbefugnisse haben, wäre demnach eine Speicherung nicht möglich, da hier die Sicherheit nicht garantiert werden kann. Wegen des grundsätzlich einheitlichen europäischen Datenschutzrechts (in Form der DSGVO) kann man davon ausgehen, dass die Sicherheit überall in der EU ungefähr gleich gewahrt wird, sodass Datenexporte innerhalb der EU relativ unproblematisch sind. Der Europäische Gerichtshof hat aus diesem Grund aber z. B. bereits zweimal in den „Schrems I“ und „Schrems II“-Entscheidungen ein Abkommen zwischen der EU und den USA für rechtswidrig erklärt, dass die Datenübermittlung in die USA zugelassen hatte.

Hintergrundinfo:

Die Aussage, dass die Sicherheit überall in der EU ungefähr gleich gewahrt wird, ist in der Praxis leider falsch, da die Irische Datenschutzbehörde anscheinend bei der Aufgabenverteilung nicht richtig zugehört und statt „Datenschutz“ eher „Warten auf Schutz“ verstanden zu haben scheint, weshalb sie sich durch eine einzigartige Untätigkeit bzw. Langsamkeit auszeichnet.

Beteiligung der Betroffenen

Aber selbst eine legitime und sichere Verarbeitung personenbezogener Daten kann erhebliche Nachteile für die Personen mit sich bringen, die von der Verarbeitung betroffen sind. Beispielsweise kann die negative Einschätzung einer Wirtschaftsauskunftei dazu führen, dass den Betroffenen ein Mietvertrag oder ein Bankkonto verweigert wird. Die Auswirkungen hiervon sind ggf. katastrophal; sie können bis zum vollständigen Ausschluss der Teilnahme am Sozial- und Wirtschaftsleben reichen.

Daher erscheint es angemessen, den Betroffenen eine Möglichkeit zu geben, selber auch auf die Modalitäten und den Inhalt der Datenverarbeitung Einfluss zu geben. Im Folgenden werde ich zeigen, dass es im Wesentlichen drei Mittel gibt, die den Betroffenen offenstehen müssen: Auskunft, Berichtigung und Unterlassung.

Recht auf Auskunft

Betroffene würden schon im Grundsatz daran gehindert, die Verarbeitung der sie betreffenden personenbezogenen Daten zu beeinflussen, wenn sie nicht wissen und nicht erfahren können, welche Daten in Bezug auf sie überhaupt wie und zu welchen Zwecken verarbeitet werden. Gerade die Unsicherheit, welche Daten in Bezug auf einen verarbeitet werden, führt zu den „chilling effects“, vor denen das Bundesverfassungsgericht so eindrücklich warnt.

Daher müssen die Betroffenen (und potentielle Betroffene) eine Möglichkeit haben, Auskunft darüber zu erhalten, welche Daten in Bezug auf sie verarbeitet werden. Dazu müssen sie überhaupt erst einmal erfahren, ob in Bezug auf sie personenbezogene Daten verarbeitet werden, insbesondere um welche Kategorien von Daten es sich hierbei handelt, sowie – insbesondere vor dem Hintergrund des noch zu besprechenden Berichtigungsrechts – auch den genauen Inhalt der Daten. Wenn die Daten an Dritte weitergegeben werden, so müssen die Betroffenen auch erfahren können, an wen und zu welchen Zwecken die Daten weitergegeben werden, damit sie Legitimität der Weitergabe beurteilen und ggf. ihre Rechte auch gegenüber den Dritten ausüben können.

Über ein Recht, über das vorstehende Auskunft zu erlangen, hinaus, ist es aber allgemein wünschenswert, dass derartige Informationen den Betroffenen (oder potentiell zukünftigen Betroffenen) auch ohne gesonderte Nachfrage mitgeteilt werden. Dies liegt darin begründet, dass ein großer Teil der Menschen nicht die technischen und prozeduralen Fähigkeiten und Kenntnisse hat, um einzuschätzen, wann auf sie bezogene personenbezogene Daten erhoben und verarbeitet werden. Dies würde einerseits zu einer potentiell hohen Zahl von Anfragen „ins Blaue hinein“ führen, andererseits würde dies dazu führen, dass viele Betroffene nie in die Lage versetzt werden, die jeweilige Auskunft zu erhalten, sodass die notwendige Mitkontrolle durch die Betroffen (dazu noch später) fehlt und Verantwortliche im Wesentlichen so verfahren könnten, wie sie wollen. Daher sollten Verantwortliche auch verpflichtet sein, proaktiv entsprechende Informationen zur Verfügung zu stellen.

Recht auf Berichtigung

Die Folgen der Verarbeitung personenbezogener Daten können besonders schädlich für die Betroffenen sein, wenn die Daten, die verarbeitet werden, inhaltlich fehlerhaft sind. Die (möglichen) Auswirkungen einer negativen Einschätzung der Kreditwürdigkeit sind bereits im Allgemeinen gravierend; basiert diese Einschätzung aber auf unrichtigen oder unvollständigen Daten, so kommt noch eine fehlende Rechtfertigung hinzu, die das Übel noch dahingehend verschärft, dass die Betroffenen die Folgen ja unter keinem Gesichtspunkt sachlich zu verantworten hätten.

Aus diesem Grund müssen nicht nur die Verantwortlichen schon von sich aus dazu verpflichtet sein, bei der Verarbeitung personenbezogener Daten auf ihre Richtigkeit zu prüfen, sondern müssen die Betroffenen auch berechtigt sein, die Verantwortlichen auf inhaltliche Fehler in den Daten hinzuweisen und eine umgehende und vollständige Berichtigung zu erwirken.

Dies kann nicht nur auf die Fälle beschränkt sein, in denen die Daten von Anfang an unrichtig sind, sondern muss sich auch auf die Fälle erstrecken, in denen sich der zutreffende Wert der Daten im Nachhinein verändert, wie dies bspw. bei solchen personenbezogenen Daten wie Wohnort, Alter, Geschlecht oder Interessen der Fall sein kann, und die Daten beim Verantwortlichen an sich zweckmäßigerweise den Anspruch haben, den aktuellen Stand abzubilden.

Hintergrundinfo:

Bei der Frage, ob personenbezogene Daten richtig sind, ist natürlich auch der Kontext bzw. Anspruch an die Aussage der personenbezogenen Daten zu beachten. Sollen personenbezogene Daten einen historischen Wert darstellen, also müssen sie natürlich bei einer späteren Änderung nicht „berichtigt“ werden. Wird beispielsweise bei einem Vertrag das Alter der übrigen Vertragspartei gespeichert, z. B. weil dies für irgendwelche rechtlichen Nachweiszwecke erforderlich ist, so muss das Datum nicht zum nächsten Geburtstag angepasst werden, denn das relevante personenbezogene Datum ist hier „Alter zum Zeitpunkt des Vertragsschlusses“ und nicht „Alter“.

Gleichermaßen können damit z. B. auch nicht Antworten auf Testfragen „berichtigt“ werden, da sie ja richtig den Wissensstand zum Zeitpunkt der Abnahme des Tests darstellen. Stimmt aber die gespeicherte Antwort nicht mit der tatsächlich abgegebenen Antwort überein, so ist der Anwendungsbereich des Rechts auf Berichtigung durchaus eröffnet.

Recht auf Unterlassung

Zuletzt muss es auch ein Recht geben, zu verlangen, dass die personenbezogenen Daten nicht weiter auf eine bestimmte Weise oder allgemein verarbeitet werden. Dieses Recht ist nicht nur dann relevant, wenn sich die Interessen der oder des Betroffenen später ändern (sodass sie nicht mehr in die gleiche Richtung wie der Zweck deuten), sondern auch dann, wenn neue (oder den Verantwortlichen bisher aus einem anderen Grund unbekannte) Umstände hinzutreten, die eine Änderung der Abwägung zwischen Zweck und Betroffeneninteresse rechtfertigen.

Dies gilt jedoch nur für den Fall, dass die Verarbeitung zuvor legitim war, denn in den anderen Fällen dürfte sie schon aus dem Grund nicht stattfinden, sodass es keines besonderen Rechts der Betroffenen bedarf und insbesondere eine gesonderte Nachricht der betroffenen Person diesbezüglich eigentlich nicht erforderlich werden dürfte.

Soweit jedoch ein solches Recht erforderlich ist und ein solches Recht ausgeübt wird, so müssen die Verantwortlichen auf Grundlage der genannten Begründung erneut prüfen, ob die Verarbeitung personenbezogener Daten noch legitim ist. Dass eine Vielzahl von Personen die Verarbeitung der sie betreffenden Daten taten- und reaktionslos hinnimmt und nur ein kleiner Teil die Betroffenenrechte überhaupt ausübt, ist bei der neuerlichen Abwägung auch zu berücksichtigen; es spricht dann nämlich dafür, dass die Interessen der betroffenen Person im Zweifel als wichtiger zu beachten sind als die Interessen an der Erfüllung des Zwecks, da sie die Datenverarbeitung so störend empfindet, dass sie sich die Mühe gemacht hat, ihr ausdrücklich zu widersprechen.

Datenschutz durchsetzen

Nachdem durch die vorgenannten Anforderungen sichergestellt wird, dass personenbezogene Daten nur für legitime Zwecke verarbeitet werden, dass die Daten auf eine Weise verarbeitet werden, die sie vor dem unberechtigten Zugriff anderer schützt, und dass die Betroffenen sich auf geeignete und angemessene Weise an den Entscheidungen betreffend der Verarbeitung beteiligen können, dürfte man doch annehmen können, dass damit personenbezogene Daten genügend geschützt sind.

Damit würde man aber der naiven Annahme verfallen, dass die bloße Verpflichtung zur Erfüllung dieser Anforderungen ausreicht, um die Erfüllung der Anforderungen zu garantieren. Es ist aber ganz offenkundig so, dass auf allen Ebenen, von klein wie groß, Gesetze, die einem persönlichen Interesse widersprechen, häufiger als bloße Empfehlungen verstanden werden, wie nicht nur regelmäßig beispielsweise an roten Ampeln, an Fahrstrecken mit Geschwindigkeitsbegrenzung, bei manchen Banken in Hamburg (bekannt aus dem Weltklassiker „Steuerrecht? eher Steuerempfehlung…“) oder manchen Autokonzernen (bekannt aus der beliebten Serie „Abgasgrenzwerte? Das sind doch eigentlich nur Abgaswertvorschläge!“) zu sehen ist, sondern wie man auch daran sieht, dass Straf- und Zivilgerichte zu den ältesten überlieferten staatlichen Institutionen der Menschheit gehören.

Daher ist es offensichtlich erforderlich, dass geeignete Rahmenvorschriften und Verfahrensweisen errichtet werden, mit denen die zuvor genannten Anforderungen durchgesetzt werden. Dabei ist es zweckmäßig, zunächst den Verantwortlichen aufzugeben, bei sich selber die Datenschutzvorschriften durchzusetzen und zu überwachen und dafür auch Zuständigkeiten zu schaffen. Dann sollen die Betroffenen, da sie in der Regel durch Datenschutzverstöße am Meisten unmittelbar belastet werden, in die Lage versetzt werden, die Einhaltung der Datenschutzvorschriften zu kontrollieren und im Rahmen der Rechtsordnung auch durchzusetzen. Zuletzt soll es aber auch eine staatliche Aufsicht geben, die die Einhaltung der Datenschutzvorschriften allgemein überwacht, Verstöße sanktioniert und so ein gleichmäßiges Datenschutzniveau absichert.

Selbstkontrolle durch Verantwortliche

Im Rahmen der Selbstkontrolle sollen die Verantwortlichen dazu gebracht werden, dass sie die Datenschutzvorschriften von sich aus einhalten und institutionelle Rahmen schaffen, um die weitere Einhaltung, Berücksichtigung und Überwachung des Datenschutzes zu garantieren.

Dies beinhaltet zunächst die Vorgabe, Verarbeitungsprozesse so auszugestalten, dass per se nur so viele Daten verarbeitet werden, wie dies unter Berücksichtigung der Belange der Betroffenen erforderlich und angemessen ist. Hierzu sollen die Prozesse so entworfen werden, die die zuvor genannten Datenschutzprinzipien, wie Zweckbegrenzung, Datensicherheit und Ermöglichung von Betroffenenrechten im Rahmen der gegebenen technischen und organisatorischen Anforderungen so weit wie möglich beinhalten, ihrer Umsetzung aber wenigstens nicht im Weg stehen (Privacy by Design). Außerdem sollen Prozesse so gestaltet werden, dass immer, wenn nach Wahl der Betroffenen mehrere unterschiedlich intensive Verarbeitungsvorgänge möglich sind (bspw., wenn es den Betroffenen freisteht, sich für oder gegen die Weitergabe von bestimmten Daten zu Statistikzwecken zu entscheiden), standardmäßig der am wenigsten intensive Vorgang ausgewählt ist (Privacy by Default).

Sodann ist den Verantwortlichen aufzugeben, genau zu prüfen, mit wem sie zusammenarbeiten, d.h. ob ihre Partner*innen zuverlässig sind und datenschutzkonform handeln, oder ob diese für häufige Sicherheitslücken oder für ein schlechtes Datenschutz-Management bekannt sind. Hierbei soll es nicht um eine allgemeine, weite „Kontaktschuld“ gehen, aber wenn ein*e Verantwortliche*r personenbezogene Daten an andere weitergibt, um mit diesen gemeinsam Verarbeitungsvorgänge vorzunehmen (z. B. bei einem gemeinsamen Projekt von zwei Unternehmen) oder damit diese bestimmte Verarbeitungen vornehmen (wie z. B., wenn Daten in eine „Cloud“ ausgelagert werden), so hat sie*er mit der Weitergabe auch die Verantwortung dafür zu tragen, was mit den Daten im Anschluss passiert.

Auch haben Verantwortliche ihre Verarbeitungsprozesse ständig zu evaluieren, insbesondere dahingehend, ob die Verarbeitung für die bestimmten Zwecke noch erforderlich ist oder ob mildere Mittel bestehen, sowie dahingehend, ob die Anforderungen an die Datensicherheit unter Berücksichtigung neuester Entwicklungen noch erfüllt sind. Ansonsten besteht nämlich die Gefahr, dass eine große Zahl von Verarbeitungsvorgängen „historisch gewachsen“ ist und anschließend nicht mehr angefasst wird, da der jeweilige Vorgang zunächst fertig ist. Dies würde dazu führen, dass auf lange Zeit der Grundsatz der Zweckbegrenzung konterkariert wird, da die Zwecke schon auf andere Weise erreicht werden. Außerdem entwickeln sich IT-Systeme regelmäßig weiter und es werden für IT-Systeme regelmäßig Sicherheitslücken gefunden; wenn die Verarbeitungsprozesse nicht aktuell gehalten werden, steigt so stetig das Risiko, dass Unbefugte Zugriff auf die Daten erhalten.

Um diese und die weiteren vorgenannten Anforderungen zu erfüllen, ist es aber zunächst erforderlich, dass die Verantwortlichen einen Überblick über die eigenen Prozesse haben. Sind diese nämlich insgesamt undurchschaubar, so kann weder die ständige Evaluierung erfolgen, noch können Betroffenenrechte erfüllt werden, noch kann überblickt werden, ob die Zweckbegrenzung erfüllt ist oder ob Sicherheitsprobleme ggf. bestehen.

Hintergrundinfo:

Genau das ist nämlich, wie Netzpolitik.org berichtete, dem Social Media-Unternehmen Facebook passiert, einem der größten Datenverarbeiter international und das ist datenschutzmäßig sehr sehr schlecht…

Weiterhin sollen die Verantwortlichen auch interne Zuständigkeiten schaffen, die die Umsetzung des Datenschutzes überwachen. Dies hat wenigstens durch zwei Zuständigkeitsbereiche zu erfolgen, nämlich einerseits dezentral in den verschiedenen Organisationsteilen (z. B. bei einem Softwareentwicklungsunternehmen in den einzelnen Development-Teams, in dem Marketing-Team, in der Personalverwaltung, u.a.), in denen dafür zu sorgen ist, dass Personen mit Datenschutzkenntnissen an allen Einzelentscheidungen mitwirken und die Datenschutzsichtweise frühzeitig und konsequent einbringen, sowie andererseits zentral durch eine Stelle, die die Beachtung der Datenschutzgrundsätze überwacht, dafür sorgt, dass die Einbringung der Datenschutzsichtweise allgemein funktioniert, und außerdem als zentrale Beratungs-, Anlauf- und Überwachungsstelle zur Verfügung steht. Durch diese Zweiteilung kann eine effektive Umsetzung gesichert werden, denn dann wird in jedem Organisationsteil Datenschutz als Teil der Hauptaufgabe gesehen und eingebracht, sodass datenschutzfreundliche Prozesse entstehen und entsprechend dokumentiert werden, gleichzeitig besteht aber auch eine zentrale Stelle, die das große Bild vor Augen hat und dafür sorgt, dass die rechtlichen Vorgaben insgesamt eingehalten werden, ohne durch eigene Mitwirkung befangen zu sein.

Kontrolle durch Betroffene

Wie in der Einleitung zu diesem Abschnitt dargelegt, genügt es nicht, darauf zu hoffen, dass Verantwortliche sich bereiterklären, den Verpflichtungen, die sich aus den Datenschutzanforderungen ergeben, freiwillig nachzukommen. Es liegt daher nahe, die Personen zu ermächtigen, die Verarbeitung auf ihre Rechtmäßigkeit zu kontrollieren, die durch sie am meisten Betroffen sind, nämlich die Betroffenen.

Dabei sind die Betroffenen zunächst auf die bereits zuvor angesprochenen Betroffenenrechte zu verweisen, mit denen ihnen geeignete Mittel zur Verfügung stehen, um Auskunft zu erhalten und ggf. Berichtigung und Unterlassung zu erwirken. Mit der Auskunft können sich die Betroffenen darüber informieren, welche Daten von ihnen zu welchen Zwecken verarbeitet werden. Anhang dieser Informationen können sie beurteilen, ob die Daten sachlich richtig sind und ob die Verarbeitung sich in dem Rahmen hält, der durch mit ihren Interessen übereinstimmende oder ihre entgegenstehende Interessen überwiegende, d.h. akzeptable Zwecke aufgespannt wird. Ist dies nicht der Fall, so können die weiteren Betroffenenrechte auf Berichtigung und Unterlassung verwendet werden, um einen datenschutzkonformen Zustand (wieder-)herzustellen.

Aus den zuvor bereits genannten Gründen reicht die bloße Existenz der Betroffenenrechte jedoch noch nicht aus, um eine angemessene Kontrolle durch die Betroffenen zu ermöglichen. Es ist daher erforderlich, rechtliche Mittel einzuführen, mit denen Betroffene im Einzelnen eine rechtswidrige Verarbeitung oder eine Missachtung ihrer Betroffenenrechte geltend machen und effektiven Rechtsschutz erhalten können. Die danach errichteten Verfahren müssen effektiv sein, wobei insbesondere zu berücksichtigen ist, dass die Betroffenen aufgrund dieser Asymmetrie anders als die Verantwortlichen in der Regel nur wenige Kenntnisse über das genaue Verarbeitungssystem haben und ihnen auch die Überprüfung der Existenz personenbezogener Daten durch einen Zugriff auf die Datenquellen in der Regel nicht möglich sein dürfte, weshalb sicherzustellen ist, dass Rechtsbehelfe nicht deshalb zurückgewiesen werden, weil die Betroffenen nicht mit letzter Sicherheit bestimmte Eigenschaften der Verarbeitungssysteme oder die Existenz bestimmter personenbezogener Daten beweisen können.

Zugleich ist jedoch auch festzustellen, dass die Nachteile, die die Verarbeitung personenbezogener Daten mit sich bringen kann, häufig nicht durch eine nachträgliche Feststellung der Unzulässigkeit eines bestimmten Handelns ausgeglichen werden können. Sobald Daten an Dritte gelangt sind, kann in der Regel auf keine Weise mehr sichergestellt werden, dass diese Daten nicht, nicht mehr oder nicht auf eine bestimmte Weise verarbeitet werden, insbesondere weil Daten faktisch unbegrenzt duplizierbar sind. Auch lassen sich die Folgen rechtswidriger Verarbeitung häufig mindern, soweit der Verarbeitungsvorgang jedoch abgeschlossen ist, lässt sich eine Verarbeitung aber nicht mehr rückgängig machen. Und auch die Nachteile, die durch die unbegründete ablehnende oder die unangemessen verzögerte Behandlung von Betroffenenrechten entstehen, lassen sich nicht vollständig durch eine nachträgliche Erfüllung beseitigen, insbesondere wenn aufgrund unrichtiger Daten rechtliche oder sonstige erhebliche Nachteile entstehen, oder wenn durch eine verweigerte Auskunft die selbstbestimmte Handlungsfreiheit der Betroffenen gehemmt oder die Ausübung sonstiger Betroffenenrechte erschwert wird. Und durch die unrechtmäßige Veröffentlichung von personenbezogenen Daten können erhebliche gesellschaftliche Nachteile bis hin zur vollständigen Isolierung der Betroffenen Person entstehen.

Diesen Nachteilen, die durch die Feststellung der Unzulässigkeit oder Rechtswidrigkeit nicht angemessen beseitigt werden können, ist gemein, dass sie sich in der Regel nicht durch direkt bezifferbare Kosten äußern. Um dennoch wenigstens irgendeine Abhilfe zu ermöglichen, ist es unbedingt erforderlich, dass wegen der Verletzung des Datenschutzes auch angemessener Schadensersatz verlangt werden kann, um wenigstens insoweit eine gewisse Linderung der Nachteile zu ermöglichen.

Allgemeine staatliche Aufsicht

Wie zuvor bereits erwähnt, kann davon ausgegangen werden, dass nur ein vergleichsweise kleiner Teil der Betroffenen jemals von ihren Betroffenenrechten Gebrauch macht und dass nur ein noch kleinerer Teil die nach dem vorherigen Teil zur Verfügung stehenden Mittel in Anspruch nimmt, um gegen eine unbegründete Ablehnung der Betroffenenrechte, eine unangemessene Verzögerung ihrer Erfüllung oder eine per se rechtswidrige Verarbeitung vorzugehen. Damit dennoch ein allgemeines, hohes Datenschutzniveau besteht und nicht Verantwortliche in Erwartung einer nur geringen Durchsetzung durch die Betroffenen taktische Datenschutzverstöße begehen, bedarf es einer allgemeinen staatlichen Aufsicht.

Diese hat sich im Wesentlichen durch drei Tätigkeiten zu äußern: Nämlich erstens durch die Beratung von Verantwortlichen und Betroffenen, um so Bewusstsein für Datenschutzprobleme zu schaffen und bei der Errichtung datenschutzkonformer Prozesse zu beraten. Zweitens durch die Kontrolle von Verarbeitungsvorgängen auf ihre Rechtmäßigkeit, und zwar einerseits allgemein und unter Berücksichtigung des jeweiligen Risikos der Vorgänge, ggf. auch anlasslos, andererseits wenn aufgrund von Beschwerden von Betroffenen und sonstigen Eingaben Anhaltspunkte entstehen, dass die Verarbeitung rechtswidrig sein könnte. Schließlich drittens durch die Sanktionierung rechtswidrigen Verhaltens, welche einerseits durch Auflagen und Weisungen erfolgen kann, mit denen die Verarbeitung den Datenschutzanforderungen angepasst wird, sowie andererseits, wenn eine anderweitige Abhilfe erfolglos erscheint, auch durch Strafmaßnahmen, wie beispielsweise Verwarnungen oder Bußgelder.

Dieser Text basiert auf meinem TINCON Berlin 2022-Vortrag, der anschließend nochmals erweitert, mit Bonusinformationen versehen, aktualisiert und überarbeitet wurde, bevor ich ihn hier veröffentlicht habe.